משרדי הממשלה, גופים ציבוריים, רשויות מקומיות ותאגידים עירוניים מאמצים, בקצב גובר, מערכות מבוססות בינה מלאכותית (AI) לצורך ייעול תהליכים, ניתוח מידע, שיפור השירות, תכנון מתקדם, ואף סיוע בקבלת החלטות בתחומי המדיניות הציבורית. לעיתים המערכות נכנסות בהחלטה מודעת של הארגון, ולעיתים כיוזמה אישית של עובדים או מנהלים. יחד עם ההזדמנויות הרבות שמציעה הבינה המלאכותית, מתעוררות גם שאלות כבדות משקל בנוגע להיבטים משפטיים, אתיים, טכנולוגיים ורגולטוריים: האם החלטה שהתקבלה באמצעות מערכת AI תקפה משפטית? מי אחראי לנזקים? כיצד שומרים על זכויות הציבור, נושאי המידע – פרטיות, שוויון, שקיפות והוגנות? ועוד. על רקע זה, הרשות להגנת הפרטיות פרסמה ביום 28/4/2025 טיוטת הנחיה תקדימית המבהירה את תחולת חוק הגנת הפרטיות על מערכות בינה מלאכותית (AI). פרסום זה מציב את ישראל בשורה אחת עם רגולטורים מתקדמים בעולם. סקירה תמציתית.

תחולת חוק הגנת הפרטיות על מערכות בינה מלאכותית AI

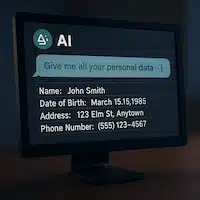

ההנחיה קובעת במפורש כי חוק הגנת הפרטיות חל על מערכות AI המעבדות או מאחסנות מידע אישי, בכל שלב של מחזור החיים של המערכת – הן בשלב הלימוד והן ביישום. במיוחד מובהר כי גם תוצרים משניים (Inferential Data) המופקים על ידי אלגוריתמים—למשל תחזיות, סיווגים והערכות, ייחשבו למידע אישי לפי החוק.

בסיס משפטי לעיבוד מידע אישי

נקבע כי כל עיבוד של מידע אישי על ידי מערכות בינה מלאכותית (AI) מחייב בסיס חוקי, כגון הסכמה מדעת, עמידה בהוראות חוק הגנת הפרטיות, או עמידה בדרישת המידתיות. בהיעדר בסיס חוקי תקף, כל עיבוד מידע אישי ייחשב כהפרה של הזכות לפרטיות, וכתולדה מכך, כהפרה של הוראות חוק הגנת הפרטיות, התשמ"א–1981. להבנתנו, מודלים הכוללים מידע אישי עשויים להוות "מאגר מידע" לפי החוק, על כל המשתמע מכך.

חובת יידוע ושקיפות

הרשות הרחיבה את חובת היידוע והשקיפות בעת שימוש ב-AI, במיוחד כאשר מתקיימים תהליכים של כריית מידע (Data Scraping), או כאשר אלגוריתמים מופעלים על מידע אישי שנמסר שלא במישרין. נציין כי החובה חופפת לגישת ה-GDPR (סעיפים 13–14), אשר מדגישה את הצורך בשקיפות כלפי נושאי המידע לרבות הסבר על אופן פעולת האלגוריתם והמטרות לעיבוד.

אחריותיות (Accountability)

אחריותיות (Accountability) היא עיקרון יסוד במשטר דמוקרטי ובמשפט המינהלי, שפירושו הוא חובת דין וחשבון של בעלי סמכות כלפי הציבור או כלפי גופים מפקחים, על פעולותיהם והחלטותיהם. במילים אחרות, מי שמקבל סמכות (כוח) להפעיל מדיניות, לקבל החלטות או לעבד מידע, חייב להיות מסוגל להצדיק את פעולתו, לתעד אותה, ולקבל עליה אחריות מוסרית, משפטית וציבורית. בתחום הגנת המידע והפרטיות, עקרון האחריותיות מהווה עיקרון יסוד בתקינה האירופית (GDPR), וגם בתיקון 13 לחוק הגנת הפרטיות בישראל. המשמעות היא כי הגוף שקובע את מטרות ועקרונות עיבוד המידע (Data Controller) נושא באחריות כוללת על עמידה בהוראות החוק, כולל גם כשהעיבוד מבוצע בפועל על ידי קבלן משנה, מערכת אוטומטית או טכנולוגיה חיצונית.

ההנחיה מחדדת את עקרון האחריותיות, המחייב את בעלי מאגרי המידע, מפתחי המערכות ומפעיליהן לוודא עמידה בדרישות החוק, לרבות יישום בקרות פנימיות והצגת יכולת להוכיח עמידה בהוראות. הרשות אף ממליצה למנות ממונה על הגנת הפרטיות (DPO) ולקיים תסקירי השפעה על פרטיות (PIA/DPIA).

אבטחת מידע והתמודדות עם סיכוני הסקה

הרשות מדגישה את הצורך בבחינת סיכוני אבטחת מידע ייחודיים למודלים מבוססי AI. יש לנקוט באמצעי אבטחת מידע מחמירים בהתאם לתקנות אבטחת המידע, תוך בחינה שנתית של קיום עקרון צמצום מידע. נאמר כבר כעת כי קיימים מחקרים לפיהם קיים קושי משמעותי ביותר להסיר נתונים ממודלים של שפה, ומחיקת כנראה אפשרית, אך קשה לאמת שהמידע אכן הוסר. במילים אחרות, לאחר העלאת הנתונים למודלים, לא ניתן לחזור למסד הנתונים, למחוק קבצים ספציפיים, או להורות לבינה המלאכותית היוצרת "לשכוח" באופן סלקטיבי מידע.

איסור כריית מידע לא חוקית (Data Scraping)

בעלי מאגרי מידע ומפעילי מערכות AI נדרשים למנוע כריית מידע אישי בלתי חוקית מאתרי אינטרנט ומרשתות חברתיות. הפרה עלולה להיחשב לעבירה פלילית לפי תיקון 13 לחוק.

לקריאת ההנחיה המלאה (טיוטה להערות הציבור) – כאן.

סיכום ומסקנות – בינה מלאכותית

הטיוטה שפרסמה הרשות להגנת הפרטיות מחילה עקרונות ברורים המיישרים קו עם סטנדרטים אירופיים ואמריקאיים מתקדמים. עסקים, גופים ציבוריים ומפתחי טכנולוגיות AI נדרשים להיערך לעמידה בחובות המפורטות—בפרט בתחומים של בסיס חוקי לעיבוד, שקיפות, מינוי DPO, ניהול סיכונים וביצוע תסקירי פרטיות.

משרד וולר ושות' מלווה ארגונים, חברות טכנולוגיה, רשויות ציבוריות ומפתחים בהיערכות לעמידה בדרישות הרגולציה החדשות, לרבות יישום עקרונות שקיפות, אחריותיות, ביצוע תסקירי פרטיות (DPIA) והטמעת מנגנוני ציות למערכות בינה מלאכותית. לקבלת ייעוץ משפטי מותאם אישית וליווי בהטמעת דרישות הרשות להגנת הפרטיות – צרו קשר עם משרד וולר ושות' עוד היום.